¿Qué son los deepfakes?

Los deepfakes son videos, imágenes o audios generados por inteligencia artificial que imitan la apariencia y voz de una persona con tal precisión que pueden engañar tanto a las personas como a los algoritmos.

Generalmente creados en tiempo real, los deepfakes se utilizan más comúnmente en videos y filtros de realidad aumentada. Aunque muchas aplicaciones para consumidores emplean esta tecnología con fines de entretenimiento —como FaceSwap— la creciente accesibilidad de esta tecnología ha llevado a su uso con fines malintencionados.

¿Cómo funcionan los deepfakes?

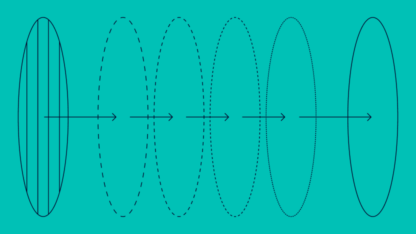

El término “deepfake” combina el aprendizaje profundo (una rama del aprendizaje automático) y la palabra «fake», refiriéndose a contenido generado mediante técnicas de inteligencia artificial.

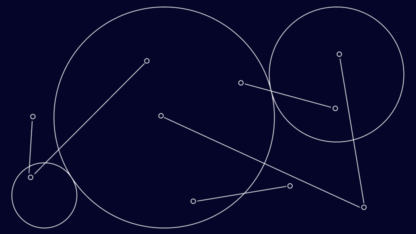

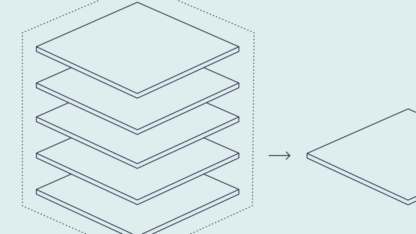

Los deepfakes se producen utilizando aprendizaje profundo y redes generativas antagónicas (GANs). Las GANs operan a través de dos redes neuronales:

- Generador: Crea imágenes, audios o videos sintéticos.

- Discriminador: Evalúa los resultados del generador e intenta distinguirlos de los datos reales.

Este proceso iterativo continúa hasta que el generador produce contenido tan convincente que el discriminador ya no puede identificarlo como falso de manera confiable.

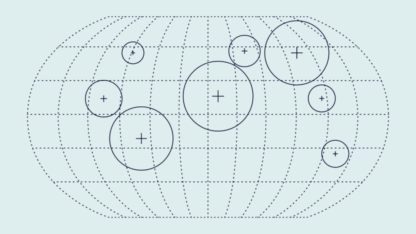

En un inicio, los deepfakes requerían grandes cantidades de datos de entrenamiento, por lo que las celebridades eran objetivos comunes. Sin embargo, los avances tecnológicos permiten ahora crear deepfakes a partir de una sola imagen o un breve clip de audio.

¿Por qué son peligrosos los deepfakes?

Los deepfakes no siempre son malintencionados, pero su uso indebido plantea riesgos graves. Se han empleado en fraudes, desinformación, extorsión y pornografía de venganza.

Un estudio de 2019 reveló que el 96% de los deepfakes detectados eran pornográficos, afectando principalmente a mujeres. También se han usado para extorsionar víctimas y explotar menores con contenido sintético explícito.

En política, los deepfakes manipulan la opinión pública y socavan la democracia. Además, afectan la seguridad digital, comprometiendo sistemas biométricos como el reconocimiento facial y de voz.

Los deepfakes son una amenaza para los procesos de verificación de identidad y onboarding de clientes en negocios. Descubre cómo gestionarlos y prevenir fraudes.

Lee más

3 ejemplos de deepfakes

Aquí te presentamos tres ejemplos destacados de deepfakes.

1. El video de Obama/Jordan Peele de Buzzfeed

Uno de los ejemplos más famosos de deepfakes que puso esta tecnología en el centro de atención fue un video lanzado en abril de 2018 por Buzzfeed. En él, aparece un Barack Obama sintético con la voz auténtica de Jordan Peele. Hasta la fecha, ha acumulado más de 8.7 millones de vistas en YouTube.

2. Personas (y gatos) que no existen – Ejemplo de imágenes deepfake

El sitio web This Person Does Not Exist genera un rostro humano nuevo utilizando GAN cada vez que lo actualizas. Aunque la mayoría de los resultados son convincentes, algunos presentan errores o un efecto inquietante propio del «valle inquietante». Este sitio es tan popular que ha inspirado versiones similares, como This Cat Does Not Exist, dedicado a crear gatos ficticios.

3. Una app que intercambia tu rostro con el de una celebridad

Disponible en la App Store y Google Play, la aplicación móvil Reface, desarrollada por Neocortext, Inc., cuenta con una calificación promedio de 4.8/5 en iOS y 4.5/5 en Android. La app permite a los usuarios intercambiar sus rostros con los de celebridades en videos, gifs y memes. Su biblioteca de contenido es en gran parte creada por la comunidad.

¿Cómo funciona el fraude con deepfakes?

El fraude con deepfakes se basa en tecnología que permite al estafador hacerse pasar por otra persona, generalmente alguien que la víctima conoce. Esto puede incluir a un gerente, el CEO de la empresa o un pariente lejano: figuras de confianza a quienes la víctima no quiere decepcionar o desobedecer, pero con quienes no interactúa lo suficiente como para notar diferencias sutiles en sus gestos o voz.

Usando el rostro y la voz de una persona de confianza, el estafador instruye a la víctima para que transfiera dinero, comparta datos sensibles o otorgue acceso no autorizado.

Este tipo de fraude ya cuenta con varios ejemplos destacados. Uno de ellos es el caso de un director general engañado por una voz deepfake creada mediante clonación de voz, quien transfirió $240,000 a un supuesto proveedor desconocido en otro país.

Cómo detectar la tecnología de deepfakes

Un deepfake a menudo provoca una sensación inquietante, revelando sutiles imperfecciones que delatan su falta de autenticidad. Entrenar el ojo humano para detectar estas inconsistencias —como movimientos faciales antinaturales, iluminación irregular o desajustes entre audio y video— y combinar esta habilidad con técnicas confiables de verificación, permite distinguir deepfakes de contenido genuino.

Señales clave que indican manipulación:

- Color de labios inconsistente con el rostro.

- Inconsistencias en la piel (demasiado lisa, muy arrugada o una edad que no coincide con el cabello).

- Sombras anómalas alrededor de los ojos.

- Problemas de reflejo en los lentes.

- Vello facial o lunares poco naturales.

- Patrones de parpadeo irregulares (muy frecuentes o casi inexistentes).

- Movimientos extraños de los labios o áreas de la boca poco realistas.

Cómo detectar la tecnología de deepfakes

Un deepfake a menudo provoca una sensación inquietante, revelando sutiles imperfecciones que delatan su falta de autenticidad. Entrenar el ojo humano para detectar estas inconsistencias —como movimientos faciales antinaturales, iluminación irregular o desajustes entre audio y video— y combinar esta habilidad con técnicas confiables de verificación, permite distinguir deepfakes de contenido genuino.

Señales clave que indican manipulación:

- Color de labios inconsistente con el rostro.

- Inconsistencias en la piel (demasiado lisa, muy arrugada o una edad que no coincide con el cabello).

- Sombras anómalas alrededor de los ojos.

- Problemas de reflejo en los lentes.

- Vello facial o lunares poco naturales.

- Patrones de parpadeo irregulares (muy frecuentes o casi inexistentes).

- Movimientos extraños de los labios o áreas de la boca poco realistas.

¿Cómo impacta el fraude con deepfakes a las empresas?

A medida que la tecnología de deepfakes se vuelve más accesible, los estafadores pueden hacerse pasar por ejecutivos, empleados o clientes con una precisión alarmante, generando vulnerabilidades significativas para las empresas. Una investigación de Regula destaca el impacto financiero, reportando pérdidas promedio de $450,000 dólares por empresa en varios sectores.

Más allá de las pérdidas financieras directas, el daño reputacional puede ser igual de grave. Los medios manipulados pueden perjudicar la imagen de una empresa, y aunque el fraude sea desmentido, el daño ya está hecho. Industrias basadas en la confianza, como las finanzas, el derecho y la salud, son especialmente vulnerables.

Con el aumento en la sofisticación de estos fraudes, los costos para las empresas también se incrementan. Ahora deben destinar recursos significativos a medidas de ciberseguridad, herramientas de detección de fraudes basadas en IA y programas de capacitación para empleados, con el fin de mitigar este riesgo creciente.

Los deepfakes son esencialmente suplantaciones, lo que los convierte en un método popular para el fraude de CEO utilizando voces sintéticas.

Los consumidores y empleados también pueden ser afectados por intentos de phishing con deepfakes, o incluso ser víctimas de robo de identidad, ya que los estafadores podrían usar esta tecnología para superar procesos de verificación KYC basados en reconocimiento facial u otras verificaciones biométricas.

Además, los criminales continúan encontrando nuevas formas de usar deepfakes, incluyendo extorsión, chantaje y espionaje industrial. Es crucial que empresas, organizaciones y particulares permanezcan alertas.

Fuentes

- Arxiv: Am I a Real or Fake Celebrity?

- Arvix: Generative Adversarial Networks

- Deepfakesweb: Online Deepfake Maker

- This Person Doesn’t Exist: Home Page

- EU Observer: ‘Deepfakes’ – a political problem already hitting the EU

- Regmedia: The State of Deepfakes

- This Cat Doesn’t Exist: Home page