¿Qué son los modelos de caja blanca?

En el ámbito del aprendizaje automático, los modelos de caja blanca (o whitebox) son sistemas diseñados para ser totalmente transparentes. A diferencia de los modelos de caja negra, que funcionan de forma opaca y solo entregan un resultado final, la caja blanca permite a los analistas observar el funcionamiento interno del algoritmo y entender los pasos lógicos que llevaron a una decisión.

En la prevención de fraude, por ejemplo, esta transparencia es fundamental. Cuando el sistema evalúa si un cliente es legítimo o un posible estafador, no solo entrega un puntaje, sino que explica qué señales de datos influyeron en esa calificación.

¿Cómo funciona la IA explicable?

Estos modelos se entrenan con grandes volúmenes de datos para identificar patrones, pero una vez activos, operan mediante reglas claras y factores ponderados que cualquier humano puede interpretar. En lugar de ser una «decisión oculta», el proceso se asemeja a un mapa de decisiones donde cada variable tiene un peso específico.

Esta claridad ofrece tres ventajas operativas:

- Control experto: Permite que los analistas revisen y refinen los criterios del modelo, mejorando la precisión con su propia experiencia.

- Trazabilidad: Facilita la auditoría de cada decisión, permitiendo verificar que el proceso sea justo y consistente.

- Agilidad de ajuste: Al entender cómo funciona el modelo, es mucho más sencillo optimizar las reglas y adaptarlas rápidamente a nuevos tipos de fraude.

¿Cómo puede la IA explicable (caja blanca) combatir el fraude?

A diferencia de la mayoría de los modelos de aprendizaje automático, que tienden a ser de caja negra, el aprendizaje automático de caja blanca es cada vez más popular en la prevención del fraude, ya que facilita la toma de decisiones rápida al procesar eficazmente grandes conjuntos de datos, al tiempo que mantiene una sensación de control para el usuario.

- Entrenamiento personalizado y configuración a medida: los algoritmos de aprendizaje automático analizan datos históricos para aprender de resultados pasados e identificar patrones de fraude. Este entrenamiento inicial combina árboles de decisión preestablecidos con requisitos específicos, creando una base para el algoritmo basada en los riesgos y necesidades únicos del negocio.

- Personalización de reglas y puntuación de fraude: los modelos de caja blanca presentan reglas legibles por humanos como árboles de decisión, permitiendo a los usuarios ajustarlas de acuerdo con las preguntas específicas o criterios que el algoritmo debe abordar. Usando estas reglas personalizadas, el algoritmo asigna una puntuación de fraude a cada transacción, incluidas estimaciones de precisión para evaluar el riesgo.

- Ajuste continuo y soporte para revisión manual: los analistas de fraude reciben información sobre las puntuaciones de riesgo, los factores ponderados y el camino del árbol de decisión, lo cual ayuda en las revisiones manuales y la verificación de decisiones.

Los usuarios pueden refinar continuamente el sistema, ajustando los umbrales de aprobación/rechazo y las reglas para adaptarse a nuevas tendencias de fraude, mejorando la precisión de detección con el tiempo.

El aprendizaje automático de caja blanca proporciona ideas claras y procesables, lo que lo hace ideal para revisiones manuales y ajustes continuos para mantener actualizadas las defensas contra el fraude. Para detalles técnicos, explora nuestra documentación sobre el aprendizaje automático interpretable (en inglés).

Mejora la detección de patrones complejos mediante modelos de caja blanca (interpretables) y caja negra, combinando transparencia con potencia analítica.

Descubre más

Caja blanca vs. caja negra: transparencia y potencia en el scoring de fraude

Hoy en día, la mayoría de los modelos de aprendizaje automático utilizan algoritmos de caja negra que producen resultados sin revelar sus procesos de toma de decisiones. Estos modelos suelen ser muy potentes en términos de precisión predictiva, pero funcionan de formas que no son fácilmente interpretables por humanos.

El proceso interno de toma de decisiones está oculto, lo que dificulta entender por qué un modelo hizo una predicción o clasificación específica. En la prevención de fraude, esta falta de transparencia dificulta la evaluación de la efectividad del modelo y plantea posibles riesgos de cumplimiento.

Si bien un enfoque de caja blanca es ideal para la detección de fraude debido a su transparencia y adaptabilidad, los modelos de caja negra también agregan valor al señalar rápidamente patrones de comportamiento nuevos o inusuales. En muchos casos, una combinación de ambos tipos de modelos puede ofrecer el mejor equilibrio entre precisión e información.

Combate el fraude con el aprendizaje automático de SEON

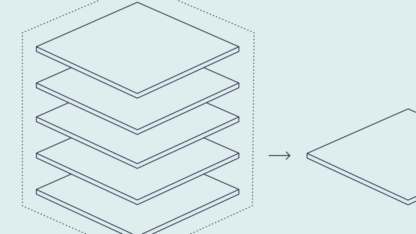

SEON combina las fortalezas del aprendizaje automático de caja blanca y caja negra para proporcionar un enfoque integral en la prevención del fraude. Nuestros algoritmos de aprendizaje automático de caja blanca te permiten implementar reglas personalizables para bloquear acciones sospechosas como transacciones fraudulentas o robo de identidad, lo que lo convierte en una excelente herramienta primaria.

Al mismo tiempo, nuestro modelo de caja negra te da una puntuación de probabilidad de fraude que es independiente de la puntuación de fraude regular, lo que significa que no tienes que correr riesgos con una herramienta no transparente. Nuestra solución también utiliza IA explicable que nos permite mostrar a nuestros clientes información sobre las correlaciones clave que influyen en la puntuación de probabilidad final.

Esta combinación ofrece tanto transparencia como capacidades avanzadas de detección, lo que hace que SEON sea una herramienta poderosa para combatir eficazmente el fraude.

El aprendizaje automático (ML) está revolucionando la detección de fraudes al analizar patrones para reducir riesgos. Este artículo cubre el papel, los beneficios, los desafíos y las aplicaciones prácticas del ML.

Impulsa tu detección de fraude con aprendizaje automático. Lee nuestro artículo sobre los beneficios y aplicaciones prácticas de esta tecnología.

Leer más